Dall-E 3如此出色,正在引发艺术家反对AI抄袭的革命-Bloomberg

Rachel Metz

Dall-E 3 网站。Dall-E 3 是由 OpenAI 创建的最新图像生成软件,可以生成几乎任何东西的图片。它可以根据简短的提示词生成人鱼的水彩肖像、个性化的生日祝福或者蜘蛛侠吃披萨的伪照片。

Dall-E 3 网站。Dall-E 3 是由 OpenAI 创建的最新图像生成软件,可以生成几乎任何东西的图片。它可以根据简短的提示词生成人鱼的水彩肖像、个性化的生日祝福或者蜘蛛侠吃披萨的伪照片。

这个在九月发布的新版本代表了人工智能创建图像的“飞跃”,OpenAI 表示。Dall-E 3 提供了更好的细节和更可靠地渲染文本的能力。这也进一步引发了插画师们对于他们将被计算机程序取代的担忧。

图像生成的快速进步促使艺术家们抵制生成式人工智能初创公司,这些公司摄取大量的互联网数据以生成图片或文本等内容。OpenAI 为那些希望将他们的数据排除在系统之外的艺术家提供的新流程耗时且复杂。一些人起诉了生成式人工智能公司。其他人则转向越来越多的数字工具,让艺术家们监控他们的作品是否被人工智能采用。还有一些人采取了轻微的破坏行为。

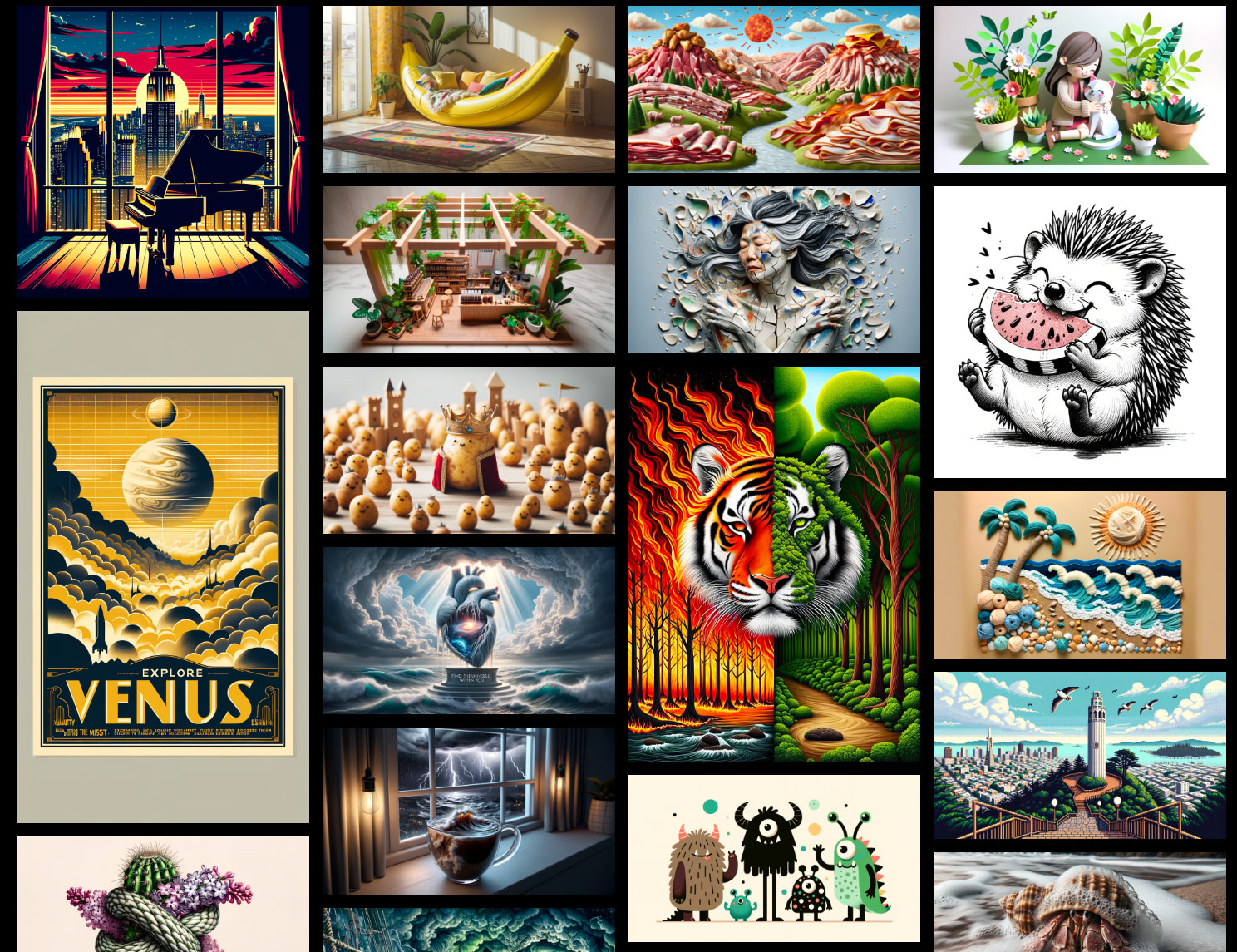

OpenAI 网站上展示的 Dall-E 3 生成的图像示例。来源:openai.com/dall-e-3目标是抵制将业务和委托失去给模仿他们的机器,这是艺术界的一种普遍情绪。“我的艺术被严重侵犯了,”插画师和水彩画家凯利·麦克凯南说。“我知道很多艺术家也有同样的感受。”

OpenAI 网站上展示的 Dall-E 3 生成的图像示例。来源:openai.com/dall-e-3目标是抵制将业务和委托失去给模仿他们的机器,这是艺术界的一种普遍情绪。“我的艺术被严重侵犯了,”插画师和水彩画家凯利·麦克凯南说。“我知道很多艺术家也有同样的感受。”

‘感觉像一场闹剧’

一些人发现他们对于人工智能系统如何使用他们的作品有限的救济途径。麦克纳是一组视觉艺术家中的一员,他们正在起诉图像生成初创公司Stability AI、Midjourney和DeviantArt — 所有这些公司,包括Dall-E 3,都生成详细且通常美丽的图片。诉讼声称他们的作品在未经许可或报酬的情况下被用来训练AI图像生成器。这些公司否认有不当行为。传统上,为训练AI软件收集在线内容被认为受到美国版权法公平使用原则的保护。10月底,该案的法官驳回了几名被告的指控,同时允许侵犯版权的指控继续进行。

这些挑战增加了人工智能公司面临的法律风险,但在这个问题上可能需要数年时间才能有结论。

与此同时,担心他们的材料被用于训练Dall-E 3的艺术家可以按照OpenAI本身提供的流程进行操作。这意味着填写一个表格请求将图像排除在公司的数据集之外,这样就不会被用来训练未来的AI系统。

这种选择退出流程最近被引入,引发了争议,因为使用起来可能耗时且繁琐,并且可能无法阻止程序模仿艺术家的风格。彭博新闻在通过ChatGPT Plus测试Dall-E 3时发现,该软件会拒绝为包含受版权保护的角色的提示生成图像,而是提供创建一个更通用选项的选择 — 这可能仍然会产生一个看起来像受版权保护的角色的图像。

例如,ChatGPT将拒绝使用Dall-E 3来创建蜘蛛侠的形象。但在彭博社的要求下,它愿意根据提示“穿着红蓝色服装的基于蜘蛛的超级英雄”来创建一个外观非常相似的角色。同样,虽然该工具不会以现存艺术家的风格创建图像,但可以使用详细描述来生成唤起特定风格的图像。

“这感觉像是一场表演,一种表面上看起来在做正确事情的方式,”概念艺术家和插画家Reid Southen说道,他曾参与过包括饥饿游戏和黑客帝国:复活在内的电影制作。

Southen表示他不会选择退出流程,估计这将花费他数月的时间。该系统要求艺术家上传他们希望在未来训练中排除的图像到OpenAI,以及每幅作品的描述。对于Southen来说,这是为了激励人们不要将他们的数据从公司的训练过程中移除。

要求人们提供他们作品的副本,以便OpenAI将来避免在其上进行训练是“荒谬的,”电子隐私信息中心(EPIC)的高级法律顾问Calli Schroeder表示。她还认为艺术家不会相信该公司会遵守承诺。“因为他们是唯一从所有这些信息中受益的人,所以责任应该在于他们确保他们实际上在法律和道德上可以使用这些数据来进行他们的训练集,”Schroeder说。

在被联系进行评论时,OpenAI表示他们仍在评估让人们控制其信息使用方式的流程,并且不愿透露到目前为止有多少人完成了退出流程。“现在还处于早期阶段,但我们正在努力收集反馈,我们希望改善体验,”一位发言人说。

毒丸

对于对官方渠道不满意的艺术家来说,还有其他选择。一家名为Spawning Inc.的公司创建了一个名为“我是否被训练过”的工具,让艺术家可以查看他们的作品是否被用来训练某些AI模型,并帮助他们选择退出未来的数据集。另一个服务是Glaze,微调图像中的像素,使其在计算机看来好像是不同风格的艺术。Glaze于八月发布,已经被下载了150万次(还有一个只限邀请的基于网络的服务有2300个在线账户)。

Glaze的创始人是芝加哥大学的教授本·赵,他的下一个项目将更进一步。在未来几周,赵计划推出一个名为Nightshade的新工具,它将作为一种AI毒丸,希望艺术家们会使用它来保护自己的作品,同时可能阻止那些基于这些数据训练的AI模型。

它将通过微调图片使其在AI系统看来完全不同。例如,通过Nightshade微调过的城堡的图像,对于一个人来说仍然会被认为是描绘同一座城堡的 — 但是一个训练于该图像的AI系统会将其归类为不同的东西,例如一辆卡车。希望通过使一些图像对模型有害而不是有益来阻止泛滥的数字抓取。

赵并不认为Nightshade是艺术家问题的解决方案,但他希望能让他们在网上对自己的作品有一种控制感,并改变AI公司收集训练数据的方式。

“我并不是特别恶意,想要对任何公司造成伤害,”赵说道。“我觉得很多地方做了好事。但这是一个共存和良好行为的问题。”