谷歌的人工智能一直在产生幻觉有人在意吗?- 彭博社

Parmy Olson

不要那么快。

不要那么快。

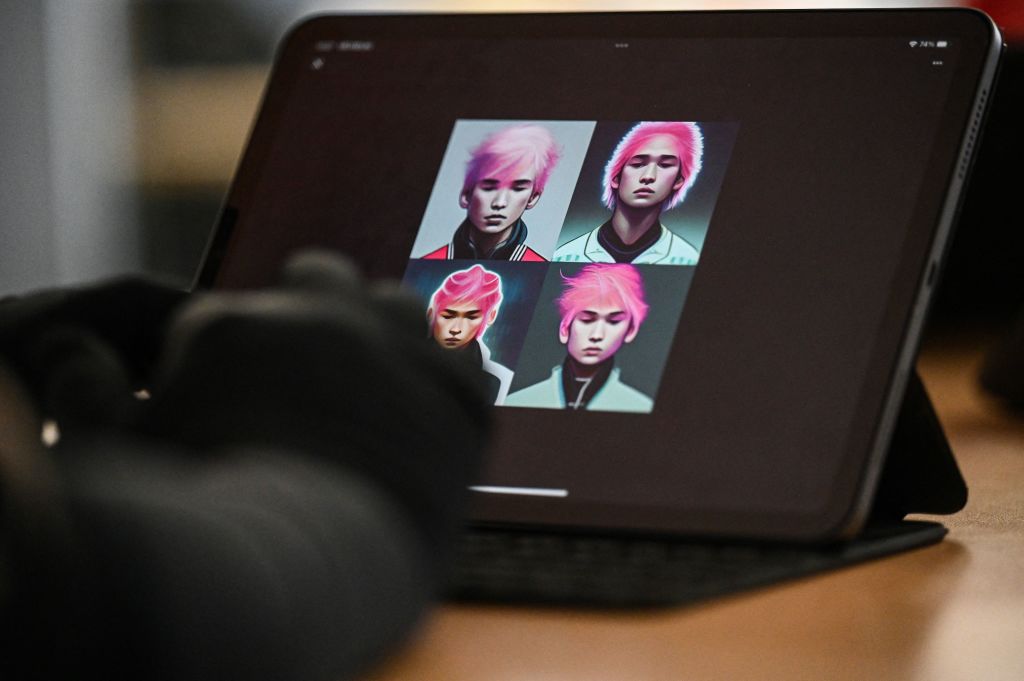

摄影师:彭博社/彭博社 事实还是虚构?

事实还是虚构?

摄影师:理查德·A·布鲁克斯/法新社/盖蒂图片社

多年来,“谷歌”意味着搜索网络上丰富的数据。如今,它意味着要穿过广告、垃圾邮件,以及最近出现的极不准确的人工智能答案。谷歌在过去一周推出的新 AI概览功能 导致了一连串的错误,这一定让谷歌母公司Alphabet Inc.的首席执行官桑达尔·皮查感到尴尬。当被问及奶酪从比萨饼上滑落时,它建议用户涂胶水。它向另一个用户建议,蛇是哺乳动物。

皮查对有史以来最成功、最赚钱的技术产品进行了调整,使其变得完全不可靠,甚至危险。他将其下线的倒计时已经开始。他越早这样做,越好。

彭博社观点日本正在与其自身有缺陷的领导人搏斗美国因错误的原因追捕特穆机器尚未对金融领域的主宰者构成威胁欧洲军队可能拯救台湾。真的。目前,谷歌表示,随着每一份关于幻觉的新报告,它正在完善其人工智能搜索服务(根据我的Twitter动态,这种情况正在变得越来越严重)。一位谷歌发言人告诉《The Verge》,错误发生在“通常非常罕见的查询上,并不代表大多数人的体验。” 对于一个以整理世界信息为傲的公司来说,这是一个糟糕的借口。而且,不经常的搜索查询应该得到可靠的结果,因为绝大多数的谷歌搜索由一长串罕见的查询组成。

这对于一个曾经如此谨慎的公司来说是一个惊人的转变,该公司曾拒绝发布其构建的生成式人工智能技术,这项技术至少领先于OpenAI公司的ChatGPT两年。自那时以来,该公司已屈服于由微软和OpenAI引发的竞赛,二者之间引发了一系列争议。上周,OpenAI发布了ChatGPT的新版本,故意安排在谷歌的人工智能发布的次日。但在所有的匆忙中,Sam Altman搞砸了发布,并与斯嘉丽·约翰逊发生了争执。1

史蒂夫·乔布斯的2011年口号“It just works”体现了一个时代,即技术产品的可靠性标准。但越来越多的科技公司展示生成式人工智能有多么不起作用,他们将越来越难向企业客户和消费者证明其有用性。

甚至埃隆·马斯克,即将筹集60亿美元用于他的xAI初创公司,也没有在自己的SpaceX和Starlink业务中使用生成式人工智能工具,因为它们一直在犯错。“我会问它费米悖论的问题,火箭发动机设计的问题,电化学的问题,”他在本月早些时候告诉密尔肯研究所会议。“到目前为止,AI在所有这些问题上表现都很糟糕。”

如果谷歌坚持使用AI概述并保留该功能,一个明显的结果将是更多的错误信息。另一个结果是,就像我们习惯了忽略SEO垃圾信息和赞助广告一样,我们也会适应其AI制造的荒谬错误。我们会习惯于更加平庸的服务,因为几乎没有其他选择。(谷歌在搜索领域的全球市场份额已从大约十年前的87%下降到82%。)在这个新时代,我们不得不接受曾被宣传为改变世界的次级软件,需要不断事实核查。

幻觉并不是一个新问题,但似乎我们正在习惯于这个问题,这对我们不利。2023年2月,谷歌的Bard首次演示中出现错误,Alphabet的股价下跌了7%,市值蒸发了1000亿美元。周五,随着更多社交媒体上最新失误的帖子被传播,股价几乎上涨了1%。华尔街似乎并不在意。谷歌在意吗?

我们将在Pichai暂停新的人工智能功能进行进一步调整时得知,就像他在二月份暂停了Gemini图像生成器一样。这将是又一次令人羞辱的撤退,但为了让技术重新走上“正常运行”的道路,他应该这样做。

更多来自彭博观点:

想要更多彭博观点吗? OPIN <GO> 。或者您可以订阅 我们的每日新闻简报 。

是否曾经注意到科幻小说对未来技术的预测是错误的?我们没有得到飞行汽车,却得到了助长文化战争的病毒推文。我们没有手腕上的传真机,却得到了迷因。我们对人工智能也有类似的现实检验。科幻描绘了一个未来,计算机以机器人的方式提供可靠信息。然而,企业尝试将生成式人工智能工具插入基础设施后,发现这些工具“产生幻觉”并犯错误。它们几乎不可靠。而这些工具本身也不僵硬和机械化。它们几乎是异想天开的。

“我们曾以为人工智能会是‘终结者’,但事实证明它更像是毕加索,”EyeLevel.ai创始人尼尔·卡茨说,这家初创公司帮助企业获得生成式人工智能模型,使其在与数据连接时能够以95%的准确率运行。卡茨预测,在进行了另外三到五年的调试之后,这种可靠性水平将在人工智能领域普遍存在,这意味着这项技术可以对金融或医疗保健公司的核心业务产生实质性的帮助。尽管如此,这并不意味着生成式人工智能还没有对行业产生颠覆性影响。只是它的影响并非创造者所设想的那样。